Die Clarifai Reasoning Engine erreicht auf Kimi K2.5 414 Token pro Sekunde

TL;DR

Mithilfe benutzerdefinierter CUDA-Kernel und spekulativer Dekodierung, die für Reasoning-Workloads optimiert sind, haben wir auf Kimi K2.5 auf Nvidia B200-GPUs einen Durchsatz von 414 Token pro Sekunde erreicht. Damit sind wir einer der ersten Anbieter, der über 400 Token pro Sekunde bei einem Reasoning-Modell mit Milliarden von Parametern erreicht hat.

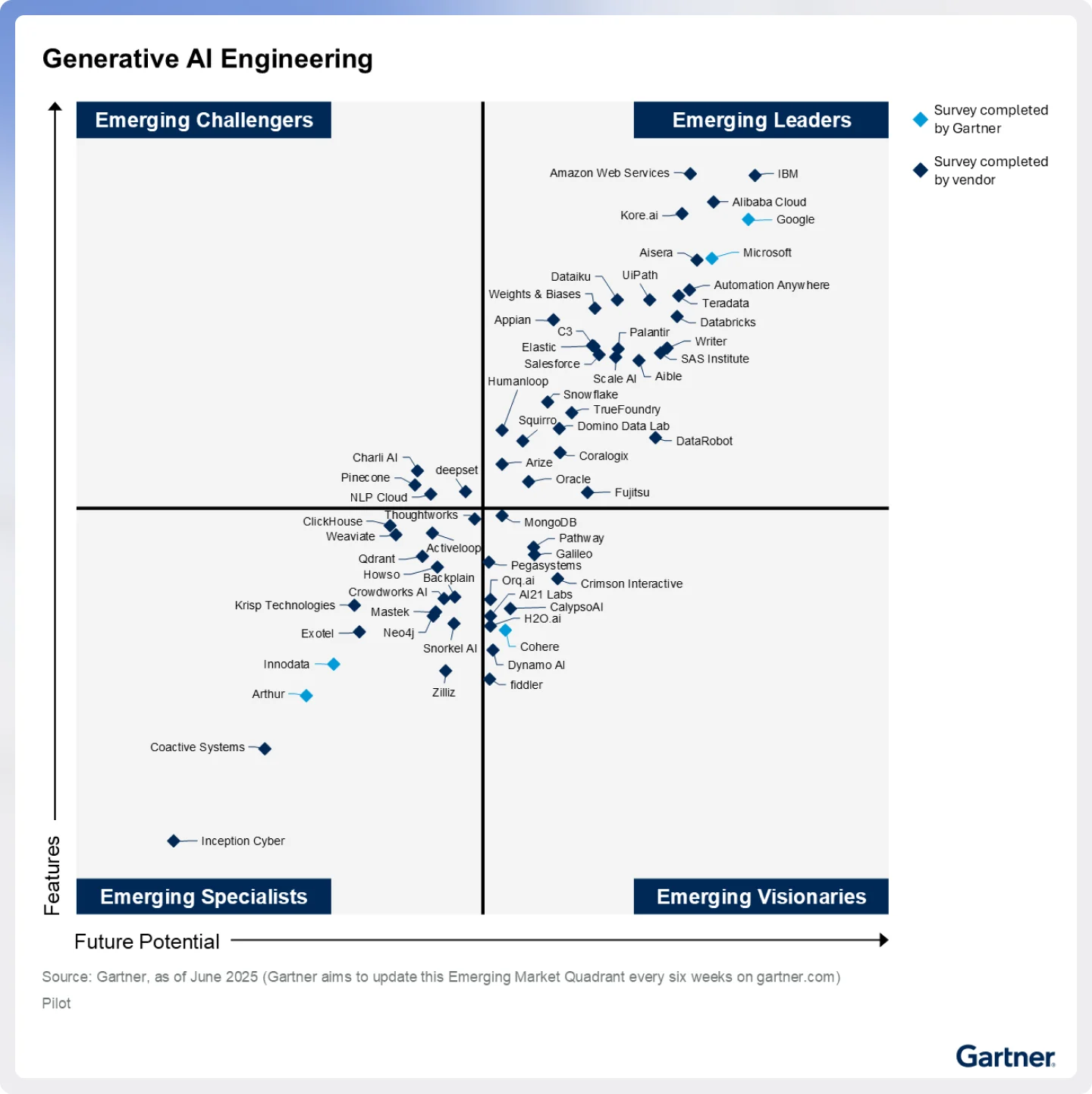

Vor der Nvidia GTC freuen wir uns, dies mitzuteilen Clarifai-Argumentationsmaschine erreichte einen Durchsatz von 414 Token pro Sekunde (TPS) auf Kimi K2.5 und positionierte uns damit, gemessen an, unter den besten Inferenzanbietern für Boundary Reasoning-Modelle Künstliche Analyse. Unsere Plattform läuft auf der Nvidia B200 GPU-Infrastruktur und bietet Leistung auf Produktionsniveau für Agenten-Workflows und komplexe Argumentationsaufgaben.

Abbildung 1: Clarifai erreicht 414 Token pro Sekunde auf Kimi K2.5 und zählt damit zu den schnellsten Inferenzanbietern bei Benchmarks für künstliche Analysen.

Warum die Leistung des Kimi K2.5 wichtig ist

Kimi K2.5 ist ein Argumentationsmodell mit 1 Billion Parametern und einer Expertenmischungsarchitektur aus 384 Experten, die 32 Milliarden Parameter pro Abfrage aktiviert. Das von Moonshot AI mit nativem multimodalem Training auf 15 Billionen gemischten visuellen und textuellen Token erstellte Modell liefert eine starke Leistung bei wichtigen Benchmarks: 50,2 % HLE mit Tools, 76,8 % SWE-Bench Verified und 78,4 % BrowseComp.

Als Argumentationsmodell generiert Kimi K2.5 vor endgültigen Antworten längere Gedankensequenzen. Clarifai erreicht eine erste Reaktionszeit von 6 Sekunden, die die interne Reflexionszeit des Modells vor der Bereitstellung einer Antwort einschließt. Der Durchsatz wirkt sich direkt auf die End-to-End-Reaktionszeit für Agentensysteme, Codegenerierung und multimodale Argumentationsaufgaben aus. Mit 414 TPS bieten wir die für Produktionsbereitstellungen erforderliche Geschwindigkeit.

Abbildung 2: TTFT-Leistung (Time to First Response) bei Inferenzanbietern, gemessen durch künstliche Analyse mit 10.000 Eingabe-Tokens.

Wie wir den Durchsatz optimieren

Clarifai-Argumentationsmaschine verwendet drei grundlegende Optimierungen für große Argumentationsmodelle:

Benutzerdefinierte CUDA-Kernel Reduzieren Sie Speicherverzögerungen und verbessern Sie die Cache-Lokalität. Durch die Optimierung von GPU-Operationen auf niedriger Ebene halten wir Streaming-Multiprozessoren während der Inferenz aktiv, anstatt auf Datenbewegungen zu warten.

Spekulative Dekodierung sagt mögliche Token-Pfade voraus und bereinigt Fehler schnell. Dadurch wird die Rechenverschwendung während der Reflektionssequenz des Modells reduziert, ein häufiges Muster bei der Arbeitsbelastung bei der Argumentation.

Adaptive Optimierung lernt kontinuierlich aus dem Belastungsverhalten. Das System passt die Stapelverarbeitung, Speicherwiederverwendung und Ausführungspfade dynamisch an, basierend auf tatsächlichen Abfragemustern. Diese Verbesserungen häufen sich im Laufe der Zeit, insbesondere bei sich wiederholenden Aufgaben, die in Agenten-Workflows häufig vorkommen.

Der Betrieb auf der Nvidia B200-Infrastruktur bietet uns die Hardware-Grundlage, um die Leistungsgrenzen zu erweitern, während unser Inferenzoptimierungs-Stack für Verbesserungen auf Softwareebene sorgt.

Bauen Sie mit Kimi K2.5

Kimi K2.5 ist jetzt auf der Clarifai-Plattform verfügbar. Probieren Sie es zunächst auf dem Playground oder über die API aus.

Wenn Sie dedizierte Rechenleistung benötigen, um Kimi K2.5 und andere ähnliche offene Modelle im großen Maßstab für Produktions-Workloads bereitzustellen, wenden Sie sich an unser Team.