Wie von Experten genehmigte Reasoning-Datensätze die Leistung von Reinforcement-Learning-Modellen verbessern

Reinforcement Learning (RL) eignet sich hervorragend zum Lernen Was Dies ist zu tun, wenn das Belohnungssignal sauber ist und die Umgebung nachsichtig ist. Aber viele reale Kontexte sind nicht so. Sie sind chaotisch, riskant und voller „fast guter“ Entscheidungen. Hier werden von Experten anerkannte Argumentationsdatensätze zu einem Kraftmultiplikator: Sie lehren Modelle Warum hinter einer Aktion, nicht nur das Ergebnis.

Der versteckte Engpass bei der RL-Leistung: schwache Argumentationssignale

RL-Agenten können während des Trainings beeindruckend aussehen und dennoch beim Einsatz scheitern. Ein häufiger Grund ist, dass das Modell Abkürzungen lernt, also Muster, die in vertrauten Szenarien belohnt werden, aber zusammenbrechen, wenn sich die Bedingungen ändern.

Hier ist eine kleine Geschichte, die Sie erkennen werden, wenn Sie RL-Systeme ausgeliefert haben:

Ein Lagerroboterteam schult einen Agenten darin, Artikel auszuwählen und zu platzieren. In der Simulation steigen die Erfolgsquoten schnell. Doch auf realen Böden beginnt der Roboter mit dem Aufbau zu „spielen“ und nimmt riskante Flugbahnen, die im Simulator funktionieren, aber in der Nähe reflektierender Oberflächen zu Kollisionen führen. Die Belohnungsfunktion war nicht falsch. DER Argumentation Das erlernte Modell war unvollständig.

Wenn Ihre Daten nur Ergebnisse erfassen („Erfolg/Misserfolg“ oder skalare Belohnung), vermissen Sie die Zwischenentscheidungslogik, die Menschen instinktiv verwenden: Einschränkungen, Sicherheitsüberprüfungen und die Reihenfolge der Schritte.

Was „von Experten verifizierte Argumentationsdaten“ wirklich beinhalten

Aus praktischer Sicht handelt es sich bei von Experten verifizierten Argumentationsdaten um eine Reihe ausgewählter Beispiele, in denen Fachexperten den Entscheidungsweg und nicht nur das Endergebnis validieren.

Spuren der Argumentation: die fehlende Mitte

Eine Argumentationsspur ist die schrittweise Reise von Beobachtung → Entscheidung → Aktion. Abhängig von Ihrem Anwendungsfall könnte dies so aussehen:

- Identifizieren relevanter Signale („Sensordrift erkannt; verringertes Vertrauen“)

- Domänenregeln anwenden („Vor dem Betreten Vorrang geben; Fußgängern Vorrang geben“)

- Wählen Sie Aktionen mit Einschränkungen aus („Wählen Sie Pfad B, um tote Winkel zu vermeiden“)

Was „verifiziert“ bedeutet (im Klartext)

„Verifiziert“ umfasst im Allgemeinen:

- Richtlinien, die von Experten verfasst oder überprüft wurden

- einheitliche Kennzeichnungsthemen (damit zwei Experten denselben Fall auf die gleiche Weise lösen)

- systematische Prüfung auf Widersprüche und fehlende Schritte

- ein Prüfpfad der Änderungen, wenn sich die Richtlinien weiterentwickeln

Dies ist wichtig, da kleine logische Fehler kaskadieren können, insbesondere wenn Sie später Belohnungsmodelle trainieren oder menschliche Feedbackschleifen verwenden.

Wie Reasoning-Datensätze die Leistung von Reinforcement-Learning-Modellen verbessern

Die Vorteile sind nicht mystisch. Sie sind mechanisch.

Schnellere Konvergenz, weniger Belohnungsentführung

Argumentationsspuren reduzieren den Suchraum. Anstatt blind zu erkunden, erhält der Agent strukturierte Signale, die ihm anzeigen, welche Zwischenschritte gültig sind. Dies bedeutet im Allgemeinen, dass weniger Trainingsiterationen in Sackgassen verschwendet werden und die Belohnungsfunktion weniger „clever“ ausgenutzt wird.

Untersuchungen zu RLHF und Belohnungsmodellierung zeigen immer wieder, wie empfindlich das Training auf verrauschte oder minderwertige Präferenz-/Feedback-Daten reagieren kann (Quelle: Association for Computational Linguistics, 2024). Diese Empfindlichkeit verschwindet bei RL nicht, sie wird verstärkt.

Bessere Verallgemeinerung auf Extremfälle

Expertencode-Argumentation Einschränkungen Und Prinzipien Dieser Transfer: Sicherheitsgrenzen, Compliance-Regeln und Kausallogik. Wenn sich die Umgebung ändert, bleiben diese Prinzipien gültig, auch wenn dies bei den genauen Übergängen in Pixeln, Text oder Zustand nicht der Fall ist.

Stabilere Belohnungsmodellierung und RLHF-Schleifen

Wenn Sie RLHF nach dem Training verwenden, helfen Ihnen die Argumentationsdaten dabei, bessere Belohnungsmodelle zu erstellen, da das Belohnungsmodell lernen kann, nicht nur „gute Antworten“, sondern auch „gute Entscheidungspfade“ zu bewerten. Dies führt zu konsistenteren Aktualisierungen während der Optimierung und zu weniger Regressionen bei der Skalierung des Trainings.

Wenn Sie RLHF-Pipelines bauen oder weiterentwickeln, basieren die RLHF-Lösungen von Shaip auf von Experten geleiteten Arbeitsabläufen und Qualitätskontrollen, die konsistente Ausrichtungsdaten unterstützen.

Eine Analogie: Flugstunden vs. Flugunterricht

Stellen Sie sich die RL-Ausbildung wie eine Pilotenausbildung vor. Sie können endlose Stunden allein in einem Simulator verbringen, aber wenn Sie sich schlechte Gewohnheiten aneignen, verstärken Sie diese. Ein Ausbilder sagt nicht einfach „bestanden/nicht bestanden“. Sie korrigieren Ihre Argumentation während des Fluges: Analysereihenfolge, Entscheidungszeitpunkt und Risikomanagement. Von Experten genehmigte Argumentationsdatensätze spielen für RL diese „Lehrer“-Rolle: das Unterrichten des Modells Wie Denken Sie an die Aufgabe, nicht nur an ihren Erfolg.

Vergleichstabelle: interne, partizipative und ausgelagerte Verifizierungsmodelle

Die meisten Teams haben am Ende einen Hybrid, aber es hilft, die Kompromisse deutlich zu machen.

Für umfassendere Kennzeichnungsanforderungen, die mit den RL- und RLHF-Pipelines verbunden sind, können die Datenanmerkungsdienste von Shaip alles unterstützen, vom Richtliniendesign bis zur mehrstufigen Qualitätssicherung, insbesondere wenn Sie reproduzierbare Qualität im großen Maßstab benötigen.

Ein praktisches Handbuch zur Qualitätskontrolle für von Experten genehmigte Argumentationsdatensätze

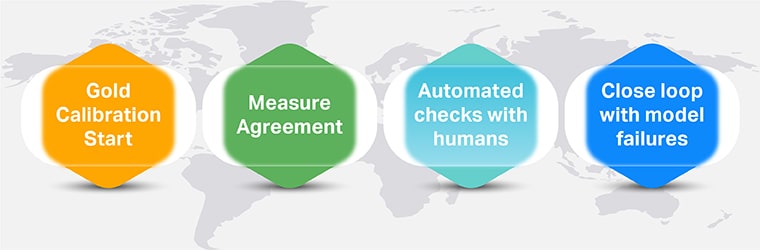

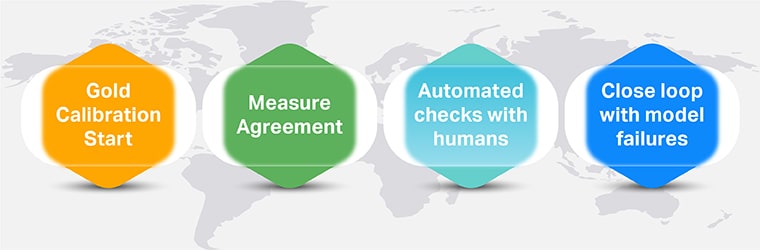

Hier ist ein Playbook, das widerspiegelt, was leistungsstarke Teams umsetzen.

1. Beginnen Sie mit „Gold“ und der Kalibrierung

Erstellen Sie eine Reihe kanonischer Beispiele (einschließlich kniffliger Randfälle). Verwenden Sie es, um Annotatoren zu kalibrieren und Experten darüber zu informieren, wie „gutes Denken“ aussieht.

2. Messen Sie die Übereinstimmung und lösen Sie dann Meinungsverschiedenheiten ordnungsgemäß

Verwenden Sie eine Vereinbarung zwischen Annotatoren, wo es sinnvoll ist (und vermeiden Sie es, eine Vereinbarung in von Natur aus mehrdeutigen Fällen zu erzwingen). Der Schlüssel ist Schlichtung: Meinungsverschiedenheiten sollten zu besseren Richtlinien führen, nicht nur zu einem Münzwurf-Etikett.

3. Fügen Sie automatisierte Kontrollen hinzu, aber lassen Sie den Menschen die Kontrolle

Automatisieren Sie, was günstig zu prüfen ist:

- Konsistenz des Formats (Anzahl der Schritte, Gültigkeit des Diagramms)

- Regelverstöße (fehlende Einschränkungen, verbotene Handlungen)

- Widerspruchserkennung (Schritt sagt „A“, später impliziert „nicht A“)

Anschließend überweisen Sie die markierten Elemente zur Expertenprüfung. Hier zahlt sich der Mensch + KI-QC-Hybrid aus: Maschinen erkennen „offensichtliche Fehler“, Experten korrigieren „subtile Fehler“.

4. Schließen Sie den Kreis bei Modellfehlern

Behandeln Sie Bereitstellungsfehler als Kommentare zu einem Datensatz. Wenn das Modell ausfällt, fragen Sie:

- Fehlte in der Spur der Argumentation eine Einschränkung?

- Wurde der Grenzfall in den Richtlinien zu niedrig spezifiziert?

- Haben wir zu viel von der Logik des „glücklichen Weges“ übernommen?

Diese Schleife verwandelt Ihren Datensatz in einen lebendigen Vermögenswert und nicht in eine einmalige Lieferung. Für Teams, die End-to-End-Datenpipelines aufbauen (Erfassung → Qualitätssicherung → Bereitstellung), können die KI-Trainingsdatendienste von Shaip dabei helfen, diese kontinuierlich zu operationalisieren.

Entscheidungsrahmen: So wählen Sie die richtige Kontrollstrategie

Verwenden Sie diese sechs Fragen, um die richtige Mischung aus internen, Crowdsourcing- und Managed Services auszuwählen: