Informationsgesteuertes Bildgebungssystemdesign – Berkeley Artificial Intelligence Research Blog

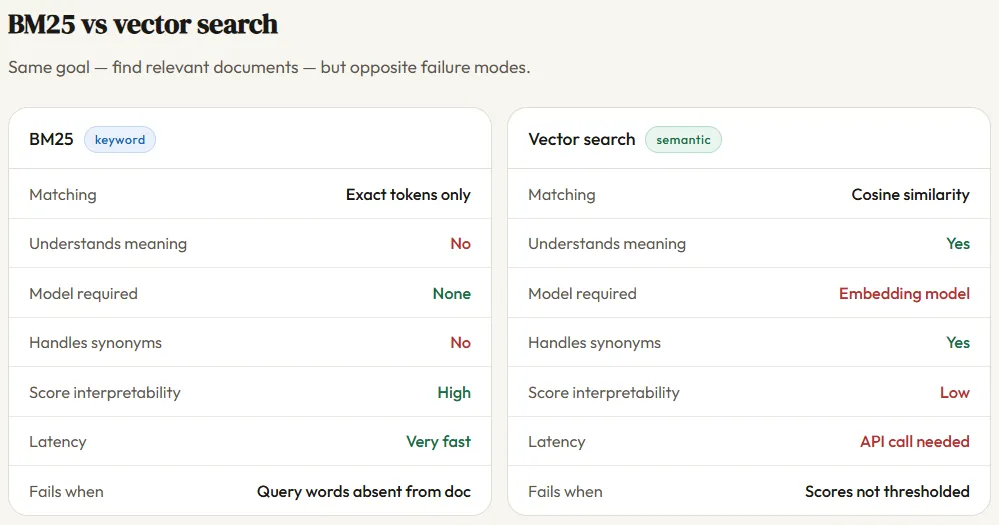

Ein Encoder (optisches System) ordnet Objekte auf rauschfreien Bildern zu, wobei das Rauschen in Messungen verfälscht wird. Unser Informationsschätzer verwendet nur diese verrauschten Messungen und ein Rauschmodell, um zu quantifizieren, wie gut die Messungen Objekte unterscheiden.

Viele bildgebende Systeme erzeugen Messungen, die Menschen nie sehen oder nicht direkt interpretieren können. Ihr Smartphone verarbeitet rohe Sensordaten durch Algorithmen, bevor das endgültige Foto erstellt wird. MRT-Scanner erfassen Messungen im Frequenzraum, die rekonstruiert werden müssen, bevor Ärzte sie anzeigen können. Selbstfahrende Autos verarbeiten Daten von Kameras und LiDAR direkt mit neuronalen Netzen.

Bei diesen Systemen kommt es nicht darauf an, wie die Messungen aussehen, sondern darauf, wie viele nützliche Informationen sie enthalten. KI kann diese Informationen extrahieren, selbst wenn sie auf eine Weise codiert sind, die Menschen nicht interpretieren können.

Dennoch bewerten wir den Inhalt von Informationen selten direkt. Herkömmliche Messgrößen wie Auflösung und Signal-Rausch-Verhältnis bewerten einzelne Qualitätsaspekte separat, was den Vergleich von Systemen, die diese Faktoren berücksichtigen, schwierig macht. Die gängige Alternative, bei der neuronale Netze trainiert werden, um Bilder zu rekonstruieren oder zu klassifizieren, kombiniert die Qualität der Bildgebungshardware mit der Qualität des Algorithmus.

Wir haben ein Framework entwickelt, das eine direkte Bewertung und Optimierung bildgebender Systeme anhand ihres Informationsgehalts ermöglicht. In unserem NeurIPS 2025-Artikel zeigen wir, dass diese Informationsmetrik die Systemleistung über vier Bildgebungsdomänen hinweg vorhersagt und dass ihre Optimierung Designs hervorbringt, die modernsten End-to-End-Methoden entsprechen und gleichzeitig weniger Speicher, weniger Rechenleistung und kein aufgabenspezifisches Decoderdesign erfordern.

Warum gegenseitige Information?

Gegenseitige Information quantifiziert das Ausmaß, in dem eine Messung die Unsicherheit über das Objekt, das sie erzeugt hat, verringert. Zwei Systeme mit der gleichen gegenseitigen Information sind in ihrer Fähigkeit, Objekte zu unterscheiden, gleichwertig, auch wenn ihre Messungen völlig unterschiedlich erscheinen.

Diese einzelne Zahl erfasst den kombinierten Effekt von Auflösung, Rauschen, Abtastung und allen anderen Faktoren, die sich auf die Messqualität auswirken. Ein verschwommenes, verrauschtes Bild, das die zur Unterscheidung von Objekten erforderlichen Merkmale beibehält, kann mehr Informationen enthalten als ein scharfes, scharfes Bild, das diese Merkmale verliert.

Die Erkenntnisse vereinen traditionell getrennte Qualitätsmaße. Es berücksichtigt Rauschen, Auflösung und spektrale Empfindlichkeit zusammen, anstatt sie als unabhängige Faktoren zu behandeln.

Frühere Versuche, die Informationstheorie auf die Bildgebung anzuwenden, stießen auf zwei Probleme. Der erste Ansatz behandelte Bildgebungssysteme als uneingeschränkte Kommunikationskanäle und ignorierte die physikalischen Einschränkungen von Linsen und Sensoren. Dies führte zu völlig ungenauen Schätzungen. Der zweite Ansatz erforderte explizite Modelle der abgebildeten Objekte, was die Allgemeingültigkeit einschränkte.

Unsere Methode vermeidet diese beiden Probleme, indem sie Informationen direkt aus den Messungen schätzt.

Schätzung von Informationen aus Messungen

Die Schätzung gegenseitiger Informationen zwischen hochdimensionalen Variablen ist bekanntermaßen schwierig. Der Probenbedarf steigt exponentiell mit der Dimensionalität, und Schätzungen leiden unter hoher Verzerrung und Varianz.

Bildgebende Systeme verfügen jedoch über Eigenschaften, die eine Zerlegung dieses schwierigen Problems in einfachere Teilprobleme ermöglichen. Die gegenseitige Information kann in der Form geschrieben werden:

\(I(X; Y) = H(Y) – H(Y \mid X)\)

Der erste Term, $H(Y)$, misst die Gesamtvariation der Messungen aufgrund von Objektunterschieden und Rauschen. Der zweite Term, $H(Y \mid X)$, misst die Variation allein aufgrund von Rauschen.

Die gegenseitige Information entspricht der Differenz zwischen der Gesamtvariation der Messung und der Variation, die nur auf Rauschen zurückzuführen ist.

Bildgebende Systeme weisen ein gut charakterisiertes Rauschen auf. Das Rauschen von Photonenschüssen folgt einer Poisson-Verteilung. Elektronisches Leserauschen ist Gaußsches Rauschen. Diese bekannte Rauschphysik bedeutet, dass wir $H(Y \mid X)$ direkt berechnen können und nur $H(Y)$ übrig bleibt, um aus den Daten zu lernen.

Für $H(Y)$ passen wir ein probabilistisches Modell (z. B. einen Transformator oder ein anderes autoregressives Modell) an einen Messwertdatensatz an. Das Modell lernt die Verteilung aller möglichen Messungen. Wir haben drei Modelle getestet, die Kompromisse zwischen Effizienz und Genauigkeit abdecken: einen stationären Gauß-Prozess (am schnellsten), einen vollständigen Gauß-Prozess (mittel) und ein autoregressives PixelCNN (am genauesten). Der Ansatz bietet eine Obergrenze für wahre Informationen; Jeder Modellierungsfehler kann nur überschätzt, niemals unterschätzt werden.

Validierung in vier Bildgebungsdomänen

Informationsschätzungen sollten die Decoderleistung vorhersagen, wenn sie die Grenzen realer Systeme erfassen. Wir haben diese Beziehung an vier Bildgebungsanwendungen getestet.

Die Informationsschätzungen prognostizieren die Leistung des Decoders in der Farbfotografie, Radioastronomie, linsenlosen Bildgebung und Mikroskopie. Höhere Informationen führen durchweg zu besseren Ergebnissen bei nachgelagerten Aufgaben.

Farbfotografie. Digitalkameras kodieren Farben mithilfe von Filterarrays, die jedes Pixel auf die Erkennung bestimmter Wellenlängen beschränken. Wir haben drei Filterdesigns verglichen: das traditionelle Bayer-Modell, eine zufällige Anordnung und eine erlernte Anordnung. Die Informationen schätzen korrekt klassifizierte Designs, die bessere Farbrekonstruktionen erzeugen würden und mit den Demosaicing-Rankings des neuronalen Netzwerks übereinstimmen, ohne dass Rekonstruktionsalgorithmen erforderlich wären.

Radioastronomie. Teleskoparrays erreichen eine hohe Winkelauflösung, indem sie Signale von Standorten auf der ganzen Welt kombinieren. Die Auswahl optimaler Teleskopstandorte ist rechnerisch komplex, da der Wert jedes Standorts von allen anderen abhängt. Die Informationsschätzungen sagen die Rekonstruktionsqualität für alle Teleskopkonfigurationen voraus und ermöglichen eine Standortauswahl ohne kostspielige Bildrekonstruktion.

Linsenlose Bildgebung. Linsenlose Kameras ersetzen herkömmliche Optiken durch lichtmodulierende Masken. Ihre Maße haben optisch keine Ähnlichkeit mit den Szenen. Die Informationen schätzen die vorhergesagte Rekonstruktionsgenauigkeit einer Linse, eines Mikrolinsenarrays und eines Diffusordesigns bei unterschiedlichen Rauschpegeln.

Mikroskopie. LED-Array-Mikroskope nutzen eine programmierbare Beleuchtung, um verschiedene Kontrastmodi zu erzeugen. Die Informationsschätzungen wurden mit der Genauigkeit des neuronalen Netzwerks bei der Vorhersage der Proteinexpression aus Zellbildern korreliert, was eine Auswertung ohne kostspielige Proteinmarkierungsexperimente ermöglichte.

In allen Fällen bedeuteten höhere Informationen eine bessere Downstream-Leistung.

Entwerfen Sie Systeme mit IDEAL

Informationsschätzungen können mehr als nur die Bewertung bestehender Systeme leisten. Unsere IDEAL-Methode (Information-Driven Encoder Analysis Learning) nutzt den Gradientenanstieg bei Informationsschätzungen, um die Parameter des Bildgebungssystems zu optimieren.

IDEAL optimiert die Parameter des Bildgebungssystems durch Gradientenrückmeldung zu Informationsschätzungen, ohne dass ein Decodernetzwerk erforderlich ist.

Der Standardansatz für rechnergestütztes Bildgebungsdesign, die End-to-End-Optimierung, trainiert gemeinsam die Bildgebungshardware und einen neuronalen Netzwerkdecoder. Dies erfordert eine Rückausbreitung im gesamten Decoder, was zu Speicherbeschränkungen und potenziellen Optimierungsschwierigkeiten führt.

IDEAL vermeidet diese Probleme, indem es lediglich den Encoder optimiert. Wir haben es am Farbfilterdesign getestet. Ausgehend von einer zufälligen Anordnung von Filtern verbesserte IDEAL das Design schrittweise. Das Endergebnis entspricht einer durchgängigen Optimierung des Informationsgehalts und der Qualität der Rekonstruktion.

IDEAL sorgt für eine durchgängige Optimierungsleistung und vermeidet gleichzeitig die Komplexität des Decoders während des Trainings.

Konsequenzen

Die informationsbasierte Bewertung eröffnet neue Möglichkeiten für eine strenge Bewertung bildgebender Systeme unter realen Bedingungen. Aktuelle Ansätze erfordern entweder eine subjektive visuelle Beurteilung, Bodenwahrheitsdaten, die während des Einsatzes nicht verfügbar sind, oder isolierte Messungen, denen die Gesamtfähigkeit fehlt. Unsere Methode liefert eine objektive und einheitliche Metrik, die ausschließlich auf Messungen basiert.

Die Recheneffizienz von IDEAL eröffnet Möglichkeiten für das Design von Bildgebungssystemen, die bisher unlösbar waren. Durch die Vermeidung der Decoder-Backpropagation reduziert der Ansatz den Speicherbedarf und die Trainingskomplexität. Wir werden diese Fähigkeiten in zukünftigen Arbeiten eingehender untersuchen.

Der Rahmen kann über die Bildgebung hinaus auf andere Bereiche der Sensorik ausgedehnt werden. Jedes System, das als deterministische Codierung mit bekannten Rauscheigenschaften modelliert werden kann, könnte von einer informationsbasierten Bewertung und Gestaltung profitieren, einschließlich elektronischer, biologischer und chemischer Sensoren.

Dieser Artikel basiert auf unserem NeurIPS 2025-Artikel „Information-Driven Design of Imaging Systems“. Der Code ist auf GitHub verfügbar. Eine Videozusammenfassung ist auf der Projektwebsite verfügbar.