Was genau lernt word2vec? – Der Berkeley Artificial Intelligence Research Blog

Was genau bewirkt word2vec lernen, und wie? Die Beantwortung dieser Frage läuft darauf hinaus, das Repräsentationslernen in einer minimalen, aber interessanten Sprachmodellierungsaufgabe zu verstehen. Obwohl word2vec Da es sich um einen bekannten Vorläufer moderner Sprachmodelle handelt, fehlte den Forschern viele Jahre lang eine quantitative und prädiktive Theorie zur Beschreibung seines Lernprozesses. In unserem neuen Artikel schlagen wir endlich eine solche Theorie vor. Wir beweisen, dass es realistische und praktische Regime gibt, in denen sich das Lernproblem reduziert ungewichtete Faktorisierung der Matrix der kleinsten Quadrate. Wir lösen die Gradientenflussdynamik in geschlossener Form; Die endgültigen gelernten Darstellungen werden einfach von PCA bereitgestellt.

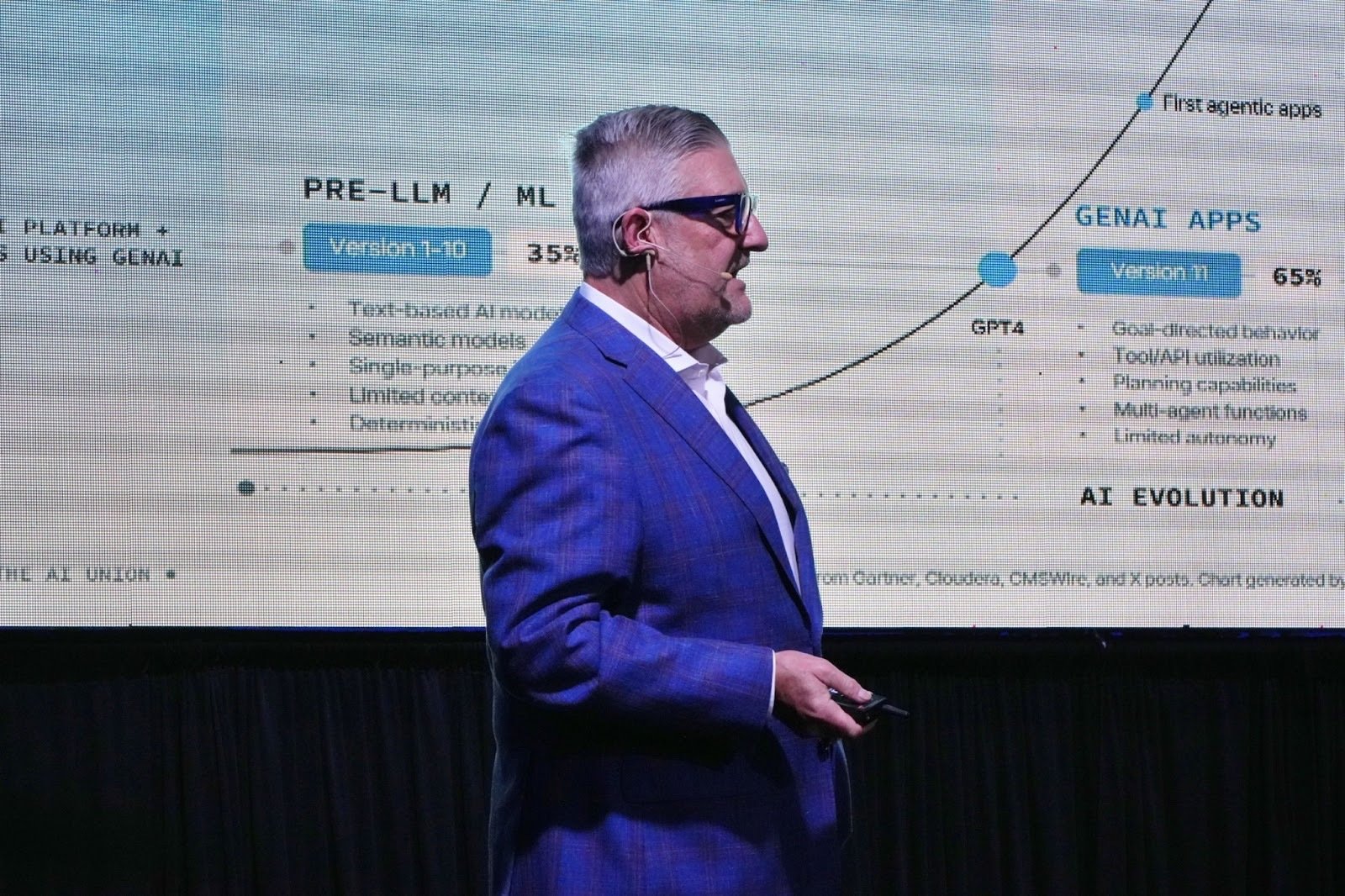

Word2vec-Lerndynamik. Wenn word2vec anhand einer kleinen Initialisierung trainiert wird, lernt es in diskreten, aufeinanderfolgenden Schritten. Links: Lernschritte durch Erhöhen des Rangs in der Gewichtsmatrix, wobei jeder den Verlust verringert. Rechts: Drei Zeitschnitte des latenten Einbettungsraums, die zeigen, wie die Einbettungsvektoren in Unterräumen zunehmender Dimension bei jedem Lernschritt wachsen, bis die Modellkapazität gesättigt ist.

Bevor wir dieses Ergebnis entwickeln, wollen wir das Problem motivieren. word2vec ist ein bekannter Algorithmus zum Lernen dichter Vektordarstellungen von Wörtern. Diese Integrationsvektoren werden mithilfe eines Kontrastalgorithmus gebildet; Am Ende des Trainings wird die semantische Beziehung zwischen zwei beliebigen Wörtern durch den Winkel zwischen den entsprechenden Einbettungen erfasst. Tatsächlich weisen erlernte Einbettungen empirisch eine auffällige lineare Struktur in ihrer Geometrie auf: Lineare Unterräume im latenten Raum kodieren häufig interpretierbare Konzepte wie Geschlecht, Verbform oder Dialekt. Dieses sogenannte Hypothese der linearen Darstellung hat in letzter Zeit große Aufmerksamkeit erregt, da auch LLMs dieses Verhalten aufweisen, was eine semantische Überprüfung interner Darstellungen ermöglicht und neue Techniken zur Modellsteuerung bereitstellt. In word2vecEs sind genau diese linearen Richtungen, die erlernte Einbettungen zu vollständigen Analogien (z. B. „Mann:Frau::König:Königin“) durch die Hinzufügung von Einbettungsvektoren ermöglichen.

Vielleicht sollte das nicht allzu überraschend sein: Immerhin ist das word2vec Der Algorithmus scannt einfach einen Textkorpus und trainiert ein zweischichtiges lineares Netzwerk, um statistische Regelmäßigkeiten in natürlicher Sprache mithilfe eines selbstüberwachten Gradientenabstiegs zu modellieren. In diesem Rahmen ist das klar word2vec ist ein minimales neuronales Sprachmodell. Verständnis word2vec ist daher eine Voraussetzung für das Verständnis des Feature-Lernens bei anspruchsvolleren Sprachmodellierungsaufgaben.

Das Ergebnis

Lassen Sie uns mit dieser Motivation im Hinterkopf das Hauptergebnis beschreiben. Nehmen wir konkret an, wir initialisieren alle Einbettungsvektoren zufällig und sehr nahe am Ursprung, sodass sie praktisch nulldimensional sind. Dann lernen die Einbettungen (unter einigen sanften Annäherungen) gemeinsam jeweils ein „Konzept“ (d. h. einen orthogonalen linearen Unterraum) in einer Folge diskreter Lernschritte.

Es ist, als würde man sich kopfüber in das Erlernen eines neuen Zweigs der Mathematik stürzen. Der ganze Jargon ist zunächst verwirrend: Was ist der Unterschied zwischen einer Funktion und einer Funktion? Was ist mit einem linearen Operator im Vergleich zu einer Matrix? Langsam, durch die Auseinandersetzung mit neuen interessanten Situationen, lösen sich Wörter im Kopf voneinander und ihre wahre Bedeutung wird klarer.

Infolgedessen erhöht jedes neu erstellte lineare Konzept effektiv den Rang der Einbettungsmatrix und gibt jedem Einbettungswort mehr Raum, um sich selbst und seine Bedeutung besser auszudrücken. Da sich diese linearen Unterräume nach dem Erlernen nicht drehen, sind sie praktisch die erlernten Merkmale des Modells. Unsere Theorie ermöglicht es uns, jedes dieser Merkmale a priori zu berechnen geschlossene Form – Dies sind einfach die Eigenvektoren einer bestimmten Zielmatrix, die ausschließlich anhand messbarer Korpusstatistiken und algorithmischer Hyperparameter definiert ist.

Was sind die Funktionen?

Die Antwort ist bemerkenswert einfach: Die latenten Merkmale sind einfach die oberen Eigenvektoren der folgenden Matrix:

\(M^{\star}_{ij} = \frac{P(i,j) – P(i)P(j)}{\frac{1}{2}(P(i,j) + P(i)P(j))}\)

wobei $i$ und $j$ Vokabularwörter indizieren, $P(i,j)$ die Wahrscheinlichkeit des gleichzeitigen Auftretens der Wörter $i$ und $j$ ist und $P(i)$ die Unigrammwahrscheinlichkeit für das Wort $i$ ist (d. h. der Randwert von $P(i,j)$).

Durch die Konstruktion und Diagonalisierung dieser Matrix aus Wikipedia-Statistiken sehen wir, dass der obere Eigenvektor Wörter auswählt, die mit den Biografien von Prominenten in Zusammenhang stehen, der zweite Eigenvektor Wörter auswählt, die mit der Regierung und der Kommunalverwaltung in Verbindung stehen, der dritte mit geografischen und kartografischen Deskriptoren und so weiter.

Was Sie beachten sollten: Während des Trainings, word2vec findet eine Folge niedrigrangiger optimaler Näherungen von $M^{\star}$. Dies entspricht tatsächlich der Ausführung von PCA auf $M^{\star}$.

Die folgenden Grafiken veranschaulichen dieses Verhalten.

Vergleich der Lerndynamik mit Darstellung diskreter und sequenzieller Lernphasen.

Links ist die wichtigste empirische Beobachtung word2vec (plus unsere weichen Näherungen) lernt in einer Folge von im Wesentlichen diskreten Schritten. Jeder Schritt erhöht den effektiven Rang der Integrationen, was zu einer progressiven Verringerung des Verlusts führt. Auf der rechten Seite zeigen wir drei Zeitschnitte des latenten Einbettungsraums und demonstrieren, wie Einbettungen bei jedem Lernschritt entlang einer neuen orthogonalen Richtung wachsen. Darüber hinaus stellen wir bei der Untersuchung der Wörter, die am stärksten mit diesen einzelnen Richtungen übereinstimmen, fest, dass jedes einzelne „Wissenselement“ einem interpretierbaren Konzept auf der Subjektebene entspricht. Diese Lerndynamiken können in geschlossener Form aufgelöst werden, und wir sehen eine hervorragende Übereinstimmung zwischen Theorie und numerischem Experiment.

Was sind die weichen Näherungen? Dies sind: 1) die quartische Näherung der Zielfunktion um den Ursprung; 2) eine besondere Einschränkung algorithmischer Hyperparameter; 3) ausreichend kleine anfängliche Integrationsgewichte; und 4) extrem kleine Abstiegsstufen. Glücklicherweise sind diese Bedingungen nicht zu stark und ähneln tatsächlich der im Original beschriebenen Einstellung ziemlich. word2vec Papier.

Vor allem betrifft keine der Näherungen die Verteilung der Daten! Tatsächlich liegt eine der Stärken dieser Theorie darin, dass sie keine Verteilungshypothese aufstellt. Als Ergebnis sagt die Theorie genau voraus, welche Merkmale im Hinblick auf Korpusstatistiken und algorithmische Hyperparameter gelernt werden. Dies ist besonders nützlich, da detaillierte Beschreibungen der Lerndynamik in einem verteilungsunabhängigen Kontext selten und schwer zu erhalten sind; unseres Wissens ist dies die erste für eine praktische Aufgabe in natürlicher Sprache.

Was die von uns vorgenommenen Näherungen angeht, zeigen wir empirisch, dass unser theoretisches Ergebnis immer eine getreue Beschreibung des Originals liefert. word2vec. Als grober Indikator für die Übereinstimmung zwischen unserer ungefähren und wahren Einstellung word2vecWir können die empirischen Ergebnisse des Standard-Analogie-Vervollständigungs-Benchmarks vergleichen: word2vec erreicht eine Genauigkeit von 68 %, das von uns untersuchte Näherungsmodell erreicht 66 % und die klassische Standardalternative (bekannt als PPMI) erreicht nur 51 %. Schauen Sie sich unseren Artikel an, um Diagramme mit detaillierten Vergleichen zu sehen.

Um die Nützlichkeit des Ergebnisses zu demonstrieren, wenden wir unsere Theorie auf die Untersuchung der Entstehung abstrakter linearer Darstellungen an (entsprechend binären Konzepten wie männlich/weiblich oder Vergangenheit/Zukunft). Wir merken, dass wir beim Lernen word2vec konstruiert diese linearen Darstellungen in einer Folge verrauschter Lernschritte, und ihre Geometrie wird durch ein angereichertes Zufallsmatrixmodell gut beschrieben. Zu Beginn des Trainings dominiert das semantische Signal; Später im Training kann jedoch das Rauschen dominieren, was zu einer Verschlechterung der Fähigkeit des Modells führt, die lineare Darstellung aufzulösen. Weitere Informationen finden Sie in unserem Artikel.

Insgesamt liefert dieses Ergebnis eine der ersten vollständigen, geschlossenen Theorien des Merkmalslernens in einer minimalen, aber relevanten Aufgabe in natürlicher Sprache. In diesem Sinne glauben wir, dass unsere Arbeit einen wichtigen Schritt im umfassenderen Projekt darstellt, das darauf abzielt, realistische analytische Lösungen zu erhalten, die die Leistung praktischer Algorithmen für maschinelles Lernen beschreiben.

Erfahren Sie mehr über unsere Arbeit: Link zum vollständigen Artikel

Dieser Artikel wurde ursprünglich auf Dhruva Karkadas Blog veröffentlicht.