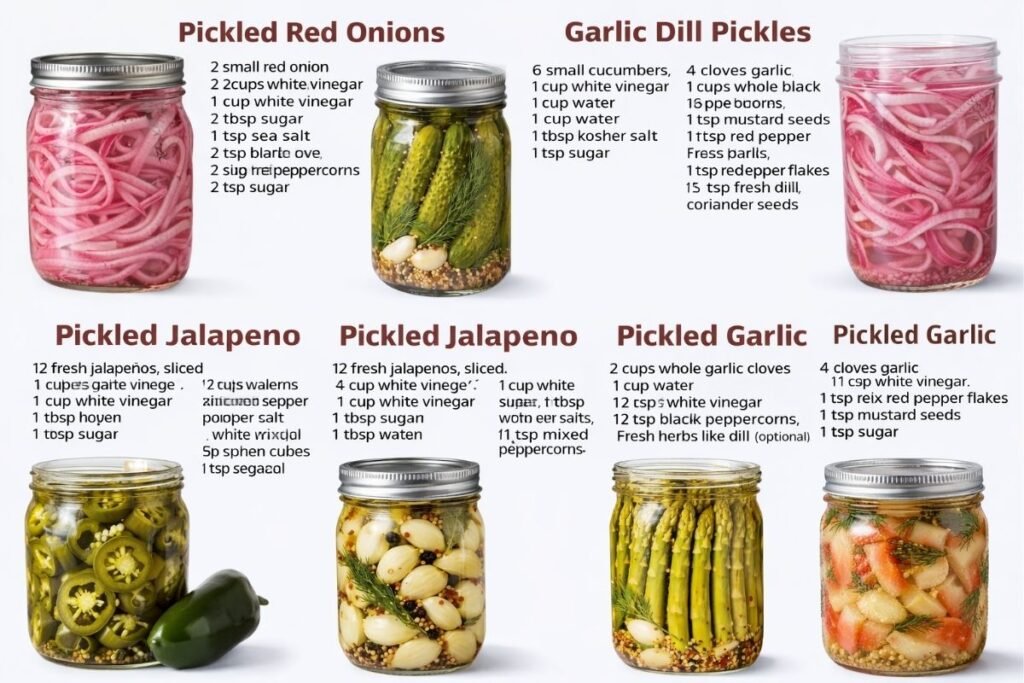

7 Easy Pickled Recipes for Bold, Flavorful Meals

Pickling is one of the simplest and most effective ways to transform everyday ingredients into something vibrant, tangy, and full of flavor. With just a few basic ingredients like vinegar, water, salt, and spices, you can create a wide variety of pickled foods that enhance meals and add a refreshing contrast to rich dishes.

Jump to RecipeThese quick pickled recipes are perfect for anyone looking to elevate their cooking without spending hours in the kitchen. Whether you are adding crunch to salads, brightness to sandwiches, or a bold kick to grilled dishes, pickled vegetables offer versatility and long-lasting flavor.

This collection includes seven easy pickled recipes, each with its own unique taste and texture. From classic red onions to more adventurous options like watermelon rind, these recipes are designed to be simple, reliable, and adaptable to your preferences.

1. Red Onion Pickles

Ingredients

• 2 small red onions

• 2 cups white vinegar

• 2 cups water

• ⅓ cup cane sugar

• 2 tablespoons sea salt

• 2 garlic cloves

• 1 teaspoon mixed peppercorns

Instructions

Thinly slice the onions and divide them between jars. Add garlic and peppercorns. Heat vinegar, water, sugar, and salt until dissolved, then let cool slightly and pour over the onions. Allow to cool to room temperature before refrigerating.

These pickled onions develop a bright color and tender texture within hours and are perfect for salads, tacos, sandwiches, and grilled meats.

2. Pickled Okra

Ingredients

• 1 pound fresh okra

• 2 cups white vinegar

• 1 cup water

• 2 tablespoons kosher salt

• 1 tablespoon sugar (optional)

• Garlic, mustard seeds, dill, pepper flakes, and peppercorns

Instructions

Briefly blanch the okra, then cool in ice water. Prepare a hot brine with vinegar, water, salt, and sugar. Pack jars with spices and okra, then pour the hot brine over them. Refrigerate or process for canning.

Pickled okra is crisp, tangy, and perfect as a snack or a flavorful side dish.

3. Pickled Garlic

Ingredients

• 2 cups peeled garlic cloves

• 1 cup vinegar

• 1 cup water

• 1 tablespoon salt

• 1 tablespoon sugar (optional)

• Mustard seeds, peppercorns, and herbs

Instructions

Blanch garlic briefly to soften its flavor. Prepare the brine and pour it over the garlic along with spices. Store in jars and refrigerate or can.

Pickled garlic becomes milder, slightly sweet, and perfect for adding depth to many dishes.

4. Pickled Watermelon Rind

Ingredients

• 4 cups watermelon rind (white part only)

• 1 cup sugar

• 1 cup vinegar

• ½ cup water

• ½ teaspoon salt

• Cloves, allspice, and cinnamon

Instructions

Cut the rind into cubes and optionally soak to reduce bitterness. Simmer in a sweet and spiced brine until tender. Transfer to jars and allow to cool before storing.

This unique recipe transforms leftover rind into a sweet and tangy treat with a slightly spiced flavor.

5. Garlic Dill Pickles

Ingredients

• 6 small cucumbers

• 1 cup vinegar

• 1 cup water

• 1 tablespoon salt

• 1 teaspoon sugar (optional)

• Garlic, dill, peppercorns, and spices

Instructions

Slice cucumbers and pack into jars with garlic and herbs. Prepare a hot brine and pour it over the cucumbers. Let cool, then refrigerate.

After 24–48 hours, the cucumbers develop a crisp texture and bold flavor, making them ideal for sandwiches or snacks.

6. Quick Pickled Jalapeños

Ingredients

• 10–12 jalapeños

• 1 cup vinegar

• 1 cup water

• 1 tablespoon sugar

• 1 tablespoon salt

• Garlic and optional spices

Instructions

Slice jalapeños and pack into jars. Pour hot brine over them and let cool before refrigerating.

These pickled jalapeños add a spicy, tangy kick to tacos, burgers, and many savory dishes.

7. Pickled Asparagus

Ingredients

• 1 lb fresh asparagus

• 2–3 cups water

• 1 cup vinegar

• 1 tablespoon salt

• 1 tablespoon sugar (optional)

• Garlic, dill, and spices

Instructions

Trim and pack asparagus into jars with spices. Pour hot brine over them and refrigerate.

After a few days, the asparagus becomes crisp and flavorful, making it a great addition to salads or appetizers.

Tips for Perfect Pickling

• Always use fresh, high-quality ingredients for the best flavor and texture

• Ensure vegetables are fully submerged in the brine to prevent spoilage

• Adjust sugar and spices depending on your taste preferences

• Allow enough time for flavors to develop—most pickles taste better after a few days

• Store refrigerator pickles in airtight containers for optimal freshness

7 Easy Pickled Recipes for Bold, Flavorful Meals

Ingredients

- 1 Red Onion Pickles

2 small red onions

2 cups white vinegar

2 cups water

⅓ cup cane sugar

2 tablespoons sea salt

2 garlic cloves

1 teaspoon mixed peppercorns

- 2 Pickled Okra

1 pound fresh okra, washed and trimmed

2 cups white vinegar (5% acidity)

1 cup water

2 tablespoons kosher salt

1 tablespoon sugar (optional, balances the vinegar)

4 cloves garlic, peeled

1 teaspoon mustard seeds

1 teaspoon dill seeds or a few fresh dill sprigs

1 teaspoon red pepper flakes (optional, for heat)

½ teaspoon black peppercorns

- 3 Pickled Garlic

2 cups whole garlic cloves, peeled

1 cup white vinegar (5% acidity)

1 cup water

1 tablespoon kosher salt

1 tablespoon sugar (optional)

1 teaspoon mustard seeds

1 teaspoon black peppercorns

Fresh herbs like dill or thyme (optional)

- 4 Pickled Watermelon Rind

4 cups watermelon rind, chopped (white part only, green outer skin removed)

1 cup sugar

1 cup white vinegar (5% acidity)

½ cup water

½ teaspoon salt

½ teaspoon whole cloves

½ teaspoon allspice berries

½ cinnamon stick (optional)

- 5 Garlic Dill Pickles (Refrigerator Style)

6 small cucumbers (Kirby or pickling cucumbers), sliced into spears or rounds

1 cup white vinegar

1 cup water

1 tbsp kosher or pickling salt

1 tsp sugar (optional)

4 cloves garlic, peeled and smashed

1 tsp whole black peppercorns

½ tsp red pepper flakes (optional, for a kick)

2–3 sprigs fresh dill (or 1 tsp dried dill per jar)

Optional: bay leaf, coriander seeds

- 6 Quick Pickled Jalapeños

10–12 fresh jalapeños, sliced into rings

1 cup white vinegar

1 cup water

1 tablespoon sugar

1 tablespoon kosher salt

2 cloves garlic, smashed

½ teaspoon oregano (optional)

½ teaspoon peppercorns (optional)

- 7 Pickled Asparagus

1 lb fresh asparagus (trimmed to fit jars)

2–3 cups water

1 cup white vinegar

1 tbsp salt (pickling or kosher)

1 tbsp sugar (optional)

Flavor Add-ins (per jar):

2 cloves garlic

1 tsp black peppercorns

½ tsp red pepper flakes (optional for heat)

1–2 sprigs fresh dill (or ½ tsp dried)

1 tsp mustard seeds (optional)

Directions

- 1 Red Onion Pickles

- Thinly slice the onions (it's helpful to use a mandoline), and divide the onions between 2 (16-ounce) jars or 3 (10-ounce) jars. Place the garlic and peppercorns in each jar, if using.

- Heat the vinegar, water, sugar, and salt in a medium saucepan over medium heat. Stir until the sugar and salt dissolve, about 1 minute. Let cool and pour over the onions. Set aside to cool to room temperature, then store the onions in the fridge.

- Your pickled onions will be ready to eat once they're bright pink and tender - about 1 hour for very thinly sliced onions, or overnight for thicker sliced onions. They will keep in the fridge for up to 2-3 weeks.

- Great in salads, tacos, burgers, sandwiches, wraps, grilled meats and more.

- 2 Pickled Okra

- If canning, sterilize jars and lids by boiling them in water for 10 minutes.

- If refrigerating, clean jars thoroughly with hot, soapy water.

- Boil okra in water for 2–3 minutes, then immediately transfer to ice water to keep them crisp. This step is optional but helps preserve a firm texture.

- In a saucepan, combine vinegar, water, salt, and sugar. Bring to a boil, stirring until salt and sugar dissolve.

- Place garlic, mustard seeds, dill, pepper flakes, and peppercorns in the bottom of each jar. Pack okra upright as tightly as possible without crushing.

- Pour the hot brine over the okra, leaving about ½ inch of headspace. Make sure all okra is submerged.

- Seal and store

- For refrigerator pickles: Let jars cool to room temperature, then cover and refrigerate for at least 3–5 days before eating.

- For canned pickles: Process in a boiling water bath for 10 minutes, then cool and store in a cool, dark place. They will last several months.

- Pickled okra is great on its own, in Bloody Marys, or as a tangy side.

- 3 Pickled Garlic

- Sterilize jars and lids by boiling 10 minutes (for canning) or clean thoroughly for fridge pickles.

- Boil peeled garlic cloves 1–2 minutes, then transfer to ice water. This softens the flavor and keeps garlic firm.

- Combine vinegar, water, salt, and sugar in a saucepan. Bring to a boil, stirring until dissolved.

- Place peppercorns, mustard seeds, and herbs (if using) at the bottom of each jar. Add garlic cloves, packing lightly but not crushing.

- Pour hot brine over garlic, leaving about ½ inch of headspace. Ensure garlic is fully submerged.

- Seal and store

- Fridge pickles: Cool, cover, and refrigerate 3–5 days before eating.

- Canning: Boil water bath 10 minutes, cool, store in a cool, dark place.

- Pickled garlic mellows in flavor, becomes slightly sweet, and is great for cooking or snacking.

- 4 Pickled Watermelon Rind

- Remove any pink flesh and the green skin. Cut into 1-inch cubes.

- Optional: Soak in cold water 1 hour to reduce bitterness.

- In a saucepan, combine sugar, vinegar, water, and salt. Bring to a boil, stirring until sugar dissolves.

- Add cloves, allspice, cinnamon, and watermelon rind to the boiling syrup. Simmer 10–15 minutes until rind is tender but still slightly crisp.

- Transfer rind and syrup into sterilized jars. Ensure rind is fully covered.

- Seal and store

- Refrigerator pickles: Cool, cover, refrigerate. Ready in 2–3 days; lasts 2–3 weeks.

- Canning: Boil water bath 10 minutes, cool, store in a cool, dark place for several months.

- 5 Garlic Dill Pickles (Refrigerator Style)

- Prep the cucumbers:

- Wash and slice cucumbers into spears or rounds. Tightly pack into a clean glass jar along with garlic, dill, and spices.

- Make the brine:

- In a small saucepan, combine vinegar, water, salt, and sugar. Bring to a boil, stirring until salt and sugar dissolve.

- Pour the brine:

- Carefully pour hot brine into the jar to fully cover the cucumbers. Tap jar gently to release any air bubbles.

- Seal and chill:

- Let cool to room temperature. Seal the jar with a lid and refrigerate.

- Ready to eat:

- Let the pickles sit in the fridge at least 24–48 hours for best flavor. They’ll keep well for up to 2 months in the refrigerator.

- 6 Quick Pickled Jalapeños

- Prepare Jalapeños: Slice jalapeños (wear gloves if sensitive). Pack tightly into a clean 16 oz jar.

- Make Brine: In a small saucepan, bring vinegar, water, sugar, salt, garlic, and spices to a boil. Stir until dissolved.

- Pour Brine: Carefully pour hot brine over jalapeños, covering them completely. Let cool to room temperature.

- Refrigerate: Seal and refrigerate for at least 24 hours before eating. Best after 2–3 days. Keeps up to 2 months refrigerated.

- 7 Pickled Asparagus

- Prep asparagus

- Wash and trim ends so they fit nicely in jars.

- Pack jars

- Place garlic, spices, and dill at the bottom. Pack asparagus upright, tight but not crushed.

- Make brine

- In a pot, bring water, vinegar, salt, and sugar to a boil. Stir until dissolved.

- Pour & seal

- Pour hot brine over asparagus, covering completely. Tap to remove air bubbles and seal jars.

- Cool & refrigerate

- Let cool to room temp, then refrigerate.

- Ready Time

- Light flavor: 24 hours

- Best flavor: 3–5 days

Notes

- Keep asparagus thin + fresh → stays crisp

Add jalapeños for spicy version

Try lemon peel for a fresh twist

Store in fridge up to 2–3 weeks

Conclusion

Pickling is a simple yet powerful technique that allows you to enhance everyday ingredients with bold, tangy flavors. With minimal effort and a few pantry staples, you can create a variety of pickled foods that elevate your meals and add a refreshing contrast to rich dishes.

These seven recipes offer a range of flavors, from classic and savory to slightly sweet and spicy, giving you plenty of options to explore. Whether you are new to pickling or looking to expand your collection, these recipes provide an easy and rewarding way to bring more flavor into your kitchen.